Элина Филатова, специалист по данным NeuronUP, в этой статье объясняет, как модель Time-Aware LSTM (TA-LSTM) позволяет с высокой точностью прогнозировать результаты пользователей, даже когда их данные генерируются нерегулярно.

В NeuronUP мы активно внедряем самые передовые методы машинного обучения, которые позволяют нам с высокой точностью предсказывать поведение пользователей, выявлять тенденции и прогнозировать будущие результаты, опираясь на их исторические данные.

Однако, традиционные подходы машинного обучения сталкиваются с трудностями, когда данные генерируются нерегулярно и интервалы между наблюдениями хаотичны или специфичны для каждого пользователя. В таких случаях классические модели становятся неэффективными, поскольку не учитывают уникальный темп и частоту активности каждого человека.

Именно чтобы решить эту проблему, мы используем специальную версию нейронной сети LSTM, называемую Time-Aware LSTM (TA-LSTM). Эта модель эффективно учитывает временные интервалы между событиями, позволяя предсказывать временные ряды даже при нерегулярных данных.

Цель исследования и основные трудности

В NeuronUP у нас есть метрики пользователя за предыдущие дни с целью предсказать их результаты при следующем выполнении активности. На первый взгляд это может показаться простой задачей, но в реальной практике возникают несколько важных трудностей:

- Индивидуальный ритм пользователей: У каждого пользователя уникальный паттерн тренировок; некоторые играют ежедневно, другие — еженедельно, а некоторые могут делать длительные паузы до месяца и неожиданно возвращаться к занятиям. Например, Алекс тренируется стабильно каждый день, тогда как Хосе предпочитает недельные интервалы. Если усреднить их результаты, не учитывая эту частоту, будут утрачены важные детали.

- Разнообразие активностей и их различное влияние на пользователей: Активности в NeuronUP разработаны для улучшения различных когнитивных функций, таких как память, внимание и логика, и др. Каждое задание имеет определённый уровень сложности, который варьируется в зависимости от пользователя. То, что для одного человека просто, для другого может представлять серьёзную сложность.

- Фокус на конкретных активностях: Специалисты NeuronUP определяют, какие активности назначать каждому пользователю. Например, Кармен регулярно выполняет упражнения на память, логику и математику, тогда как Пабло предпочитает исключительно упражнения на внимание. Следовательно, предиктивная модель должна учитывать персонализированный путь каждого игрока.

Разумеется, все эти нюансы усложняют как корректную подготовку данных, так и сам процесс обучения моделей машинного обучения. Игнорирование индивидуального ритма игроков, их нерегулярных интервалов и различных уровней сложности активностей неизбежно приводит к потере ключевой информации. В результате существует риск получения менее точных предсказаний, что, в свою очередь, может снизить эффективность персонализированных рекомендаций в NeuronUP.

Решение: Time-Aware LSTM

Чтобы эффективно преодолеть все упомянутые ранее трудности, команда данных NeuronUP разработала специальное решение, основанное на настраиваемой модели Time-Aware LSTM (TA-LSTM). Это усовершенствованная версия стандартной нейронной сети LSTM, которая способна учитывать не только события во временных рядах, но и временные интервалы между ними.

Подготовка данных: почему временная разница так важна?

Наша модель получает на вход данные, подготовленные особым образом. Каждая запись — это двумерная матрица, содержащая последовательные результаты игрока, упорядоченные хронологически, а также интервалы времени в днях между каждым выполнением активности. Чтобы понять, почему важно учитывать временную разницу, познакомимся с двумя персонажами, которые помогут нам наглядно это продемонстрировать.

Представим марафон под названием «Самый быстрый и ловкий», к которому готовятся два спортсмена:

- Нейронито – дисциплинированный и целеустремлённый спортсмен. Никогда не пропускает тренировку, работает над собой каждый день и тщательно следит за питанием. Нейронито постоянно прогрессирует: с каждой новой тренировочной сессией он становится быстрее, выносливее и увереннее в себе. Учитывая его стабильный темп подготовки, мы легко можем предсказать, что он покажет отличный результат на марафоне.

- Лентонито – талантливый, но менее дисциплинированный атлет. Его тренировки нерегулярны. Сегодня он тренируется с энтузиазмом, а завтра предпочитает отдохнуть, наслаждаясь паэльей и хорошим хамоном. Такие нестабильные сессии приводят к колебаниям в его результатах: иногда он прогрессирует, иногда нет, без устойчивого роста. Вероятно, Лентонито придёт к финишу с менее впечатляющими результатами.

Таким образом, на простом примере мы увидели, насколько интервалы времени между событиями влияют на конечные результаты. Именно эта информация о стабильности и регулярности в «тренировках» мы и передаём нашей модели.

Если не учитывать временные интервалы, модель будет воспринимать этих двух спортсменов как одинаковых, не замечая разницы в их подходе к тренировкам. Но TA-LSTM выявляет эту ключевую особенность, анализирует индивидуальные интервалы между событиями и делает более точные прогнозы, учитывая уникальный ритм каждого участника (или, в нашем случае в NeuronUP, пользователя).

Но это ещё не всё! Как вы уже заметили, мы также упомянули питание Нейронито и Лентонито. Не случайно: эти данные представляют собой дополнительные характеристики, которые также существенно влияют на итоговый результат.

Аналогично, наша модель способна учитывать не только временные интервалы, но и другие важные характеристики, такие как возраст, пол, диагноз и даже предпочтения пользователей.

Это позволяет заметно повысить точность прогнозов, как в нашем примере с героями, где мы учли их режим питания и его влияние на успех.

Технические детали

Теперь, когда мы рассмотрели основную концепцию, перейдём к техническому аспекту работы модели Time-Aware LSTM (TA-LSTM). Эта модель — модификация стандартной LSTM‑ячейки, специально разработанная для учёта временных интервалов между последовательными событиями.

Основная цель TA-LSTM — адаптивное обновление внутреннего состояния памяти модели в зависимости от времени, прошедшего с последнего наблюдения. Такой подход критичен при работе с нерегулярными временными рядами — именно с тем типом данных, с которым мы имеем дело в NeuronUP.

Вектор входных данных в момент времени t представлен как:

\[\text{входы}_{t} = [x_{t},\,\Delta t]\]Где:

- \(x_t \in \mathbb{R}^d\) — вектор признаков, описывающий текущее событие (каждый день, когда выполняется активность).

- \(\Delta t \in \mathbb{R}\) — интервал времени между текущим и предыдущим наблюдением.

Предыдущие состояния модели представлены в стандартном виде:

\[h_{t-1},\; C_{t-1}\]Где:

- \(h_{t-1}\) — вектор скрытого состояния на предыдущем шаге.

- \(C_{t-1}\) — состояние памяти (ячейка LSTM) на предыдущем шаге.

Чтобы учесть влияние временного интервала, модель использует специальный механизм затухания памяти, описываемый следующей формулой:

\[\gamma_t = e^{-\text{RELU}(w_d \cdot \Delta t + b_d)}\]Где:

- \(w_d, \; b_d\) — обучаемые параметры модели.

- \(\text{RELU}(x) = \max(0, x)\) — функция активации, предотвращающая отрицательные значения.

Коэффициент затухания \(\gamma_t\) управляет обновлением состояния памяти.

Обновление памяти определяется как:

\[\bar{C}_{t-1} = \gamma_t \cdot C_{t-1}\]Это означает, что когда интервал времени увеличивается, значение стремится к нулю, что приводит к большему «забыванию» предыдущих состояний памяти.

На следующем шаге скорректированное состояние памяти \(\bar{C}_{t-1}\) подаётся в стандартные уравнения LSTM:

\[h_t, \; C_t = \text{LSTM}(x_{t’}, h_{t-1}, \bar{C}_{t-1})\]Выходные значения \(h_t\) и обновлённое состояние памяти \(C_t\) используются на следующем шаге модели, что обеспечивает точное прогнозирование и возможность учитывать нерегулярные временные интервалы между событиями.

Зачем использовать прогнозирование?

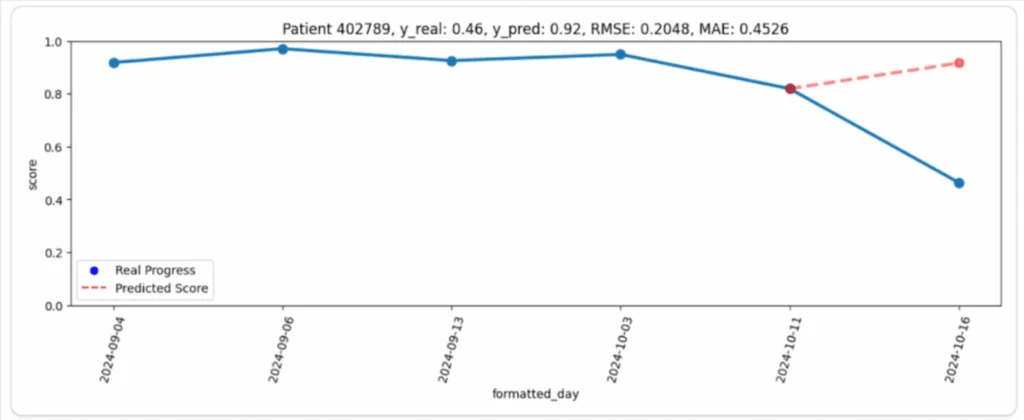

Использование прогнозирования позволяет нам с высокой точностью предвосхищать будущие результаты пациента, предварительно проанализировав его данные с помощью нашей настраиваемой модели TA-LSTM. Чтобы проверить точность прогнозов, мы взяли выборку данных реальных пациентов и применили модель, опираясь на их прежние записи активности. Последний день активности каждого пациента был исключён из данных для сравнения реального результата с прогнозом модели.

В большинстве случаев предсказанные нашей моделью результаты тесно совпадали с реальными значениями игроков. Тем не менее, мы также выявили несколько интересных исключений, в которых прогноз существенно отличался от фактического результата.

Например, на следующем графике (Изображение 1) можно наблюдать прогресс пациента (синяя линия) и соответствующий прогноз модели (красная линия). На первый взгляд разница кажется довольно большой: пациент поддерживал высокий и стабильный уровень в течение всего периода наблюдения, но его последний результат оказался неожиданно значительно ниже ожидаемого. В этом случае прогноз модели выглядел гораздо более логичным, чем реальный результат.

Почему это произошло?

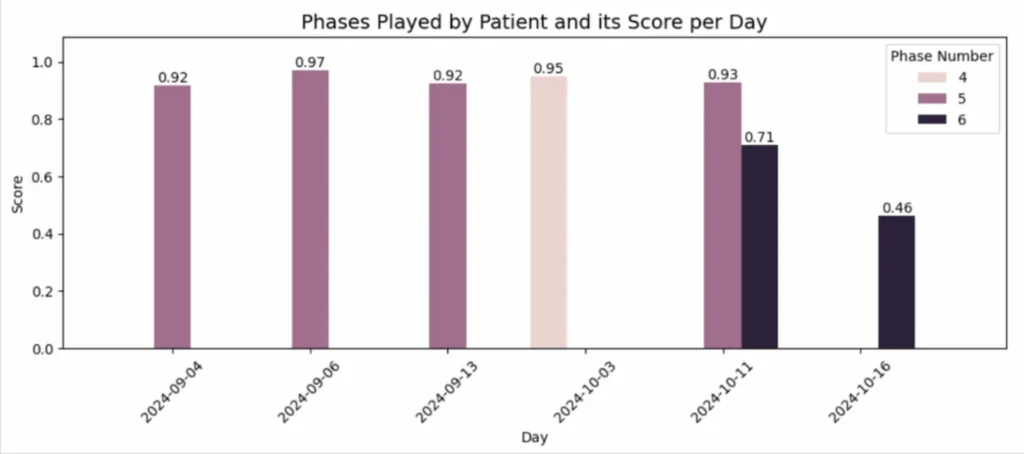

Причина оказалась простой, но важной: во все предыдущие дни пациент играл на более лёгких уровнях (фазах), получая стабильно высокие баллы. Однако в последний день он выбрал фазу 6, которая была сложнее, что вызвало заметное падение его результатов (Изображение 2).

Таким образом, прогноз модели позволил распознать неожиданное отклонение от привычного поведения пациента, выявив, что оно было вызвано повышением уровня сложности.

Этот подход даёт специалистам NeuronUP мощный инструмент для своевременного обнаружения таких ситуаций и быстрого анализа причин отклонений.

Вывод

Использование Time-Aware LSTM открывает новые возможности для точного прогнозирования временных рядов с нерегулярными интервалами. В отличие от традиционных моделей, TA-LSTM способна адаптироваться к уникальному ритму каждого игрока, учитывая его паузы и интервалы активности. Благодаря этому подходу наша платформа когнитивной стимуляции не только может точно предсказывать будущие результаты пациентов, но и своевременно обнаруживать возможные аномалии или неожиданные отклонения.

В NeuronUP мы ценим ваше время и всегда стремимся применять наиболее эффективные, инновационные и передовые технологии. Следите за нашими обновлениями — лучшее ещё впереди!

Библиография

- Lechner, Mathias, and Ramin Hasani. “Learning Long-Term Dependencies in Irregularly-Sampled Time Series.” arXiv preprint arXiv:2006.04418, vol. -, no. -, 2020, pp. 1-11.

- Michigan State University, et al. “Patient Subtyping via Time-Aware LSTM Networks.” Proceedings of the 23rd ACM SIGKDD International Conference on Knowledge Discovery and Data Mining (KDD ’17), vol. -, no. -, 2017, pp. 65-74.

- Nguyen, An, et al. “Time Matters: Time-Aware LSTMs for Predictive Business Process Monitoring.” Lecture Notes in Business Information Processing, Process Mining Workshops, vol. 406, no. -, 2021, pp. 112–123.

- Schirmer, Mona, et al. “Modeling Irregular Time Series with Continuous Recurrent Units.” Proceedings of the 39th International Conference on Machine Learning (ICML 2022), vol. 162, no. -, 2022, pp. 19388-19405.

- “Time aware long short-term memory.” Wikipedia, https://en.wikipedia.org/wiki/Time_aware_long_short-term_memory. Accessed 12 March 2025.

Если вам понравилась эта статья о la прогнозировании результатов игроков с помощью TA-LSTM, вам наверняка будут интересны эти статьи NeuronUP:

«Эта статья была переведена. Ссылка на оригинальную статью на испанском:»

Predicción de resultados de jugadores mediante TA-LSTM.

Цифровизация в нейропсихологической оценке

Цифровизация в нейропсихологической оценке

Добавить комментарий