O Q-learning (aprendizado Q em castelhano) evoluiu consideravelmente desde os primeiros experimentos comportamentais como o condicionamento clássico de Pavlov, até chegar a se tornar uma das técnicas mais importantes no âmbito do Machine Learning (aprendizado de máquina). A seguir, exploraremos como foi seu desenvolvimento e sua aplicação na neurorreabilitação e estimulação cognitiva.

Os experimentos de Pavlov

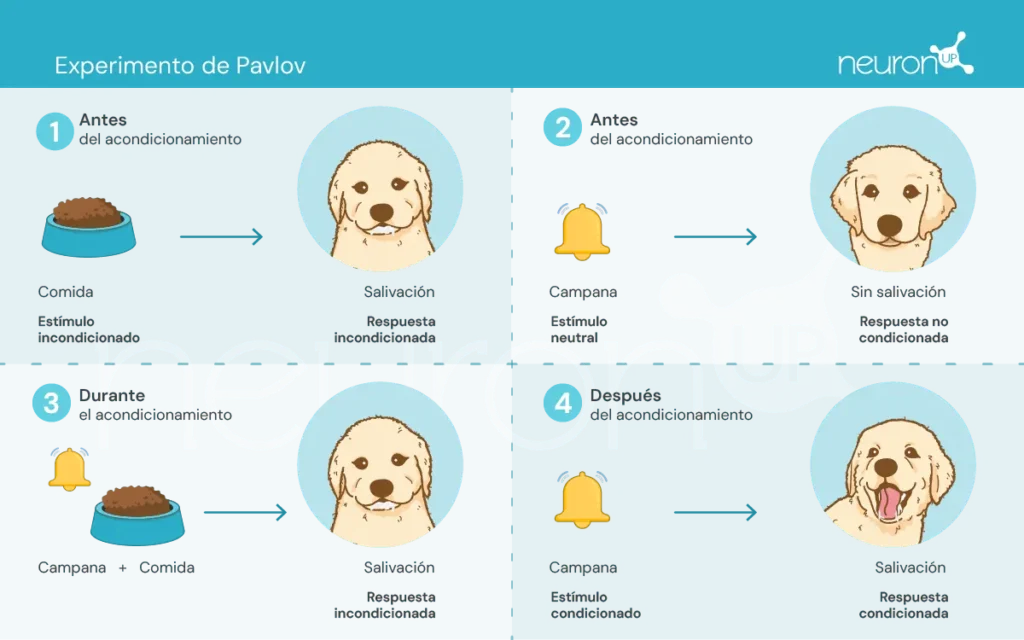

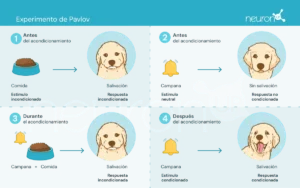

Ivan Pavlov, um fisiologista russo do final do século XIX, é reconhecido por estabelecer as bases da psicologia comportamental por meio de seus experimentos sobre o condicionamento clássico. Nestes experimentos, Pavlov demonstrou que os cães podiam aprender a associar um estímulo neutro, como o som de um sino, a um estímulo incondicionado, como a comida, provocando assim uma resposta incondicionada: a salivação.

Este experimento foi fundamental para demonstrar que o comportamento pode ser adquirido por associação, um conceito crucial que posteriormente influenciou o desenvolvimento das teorias de aprendizado por reforço.

As teorias do aprendizado por reforço

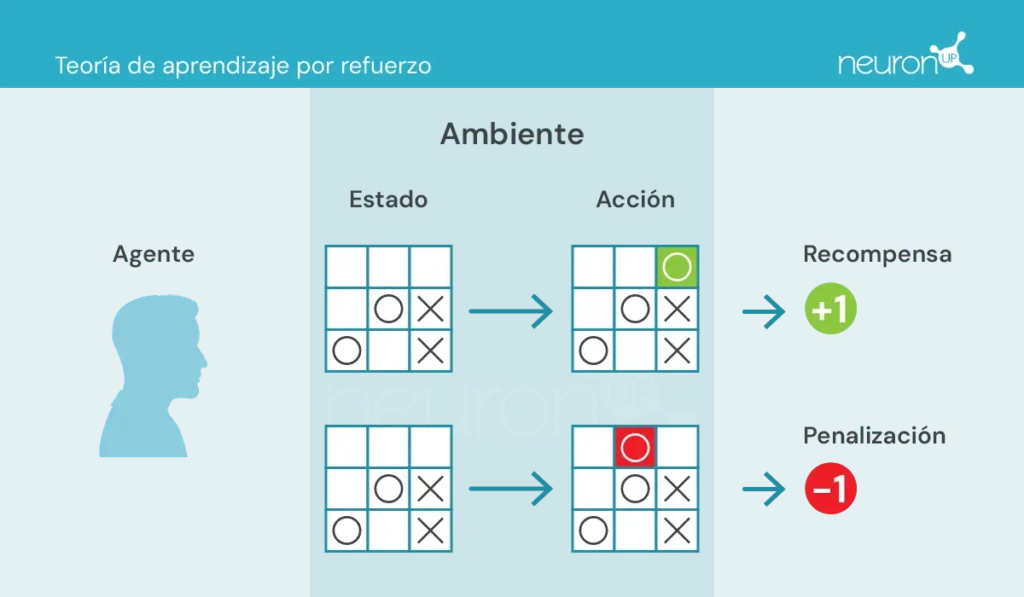

Essas teorias se concentram em como os seres humanos e os animais aprendem comportamentos a partir das consequências de suas ações, o que tem sido essencial para o desenho de algoritmos como o Q-learning.

Há alguns conceitos-chave com os quais devemos nos familiarizar antes de continuar:

- Agente: responsável por realizar a ação.

- Ambiente: entorno onde o agente se move e interage.

- Estado: situação atual do ambiente.

- Ação: possíveis decisões tomadas pelo agente.

- Recompensa: prêmios que são concedidos ao agente.

Nesse tipo de aprendizado, um agente realiza ações no ambiente, recebe informação na forma de recompensa/penalização e a utiliza para ajustar seu comportamento ao longo do tempo.

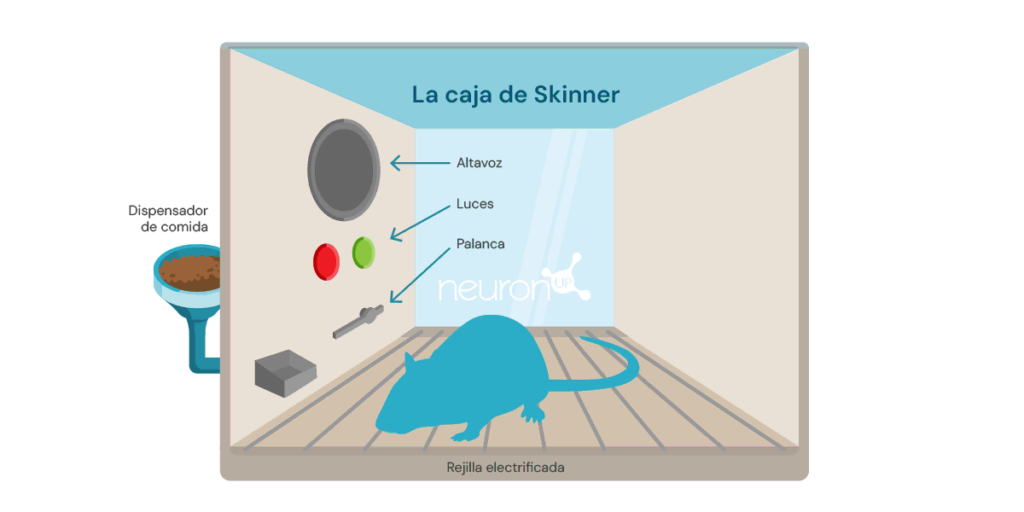

Um experimento clássico do aprendizado por reforço é o experimento da caixa de Skinner, realizado pelo psicólogo norte-americano Burrhus Frederic Skinner no ano de 1938. Nesse experimento, Skinner demonstrou que os ratos podiam aprender a pressionar uma alavanca para obter comida, utilizando o reforço positivo como meio para modelar o comportamento.

O experimento consiste em introduzir um rato em uma caixa com uma alavanca que possa pressionar, um dispensador de comida, e, em ocasiões, uma luz e um alto-falante.

Cada vez que o rato pressiona a alavanca, é liberado um grão de comida no dispensador. A comida atua como um reforço positivo, uma recompensa por pressionar a alavanca. Com o tempo, o rato começará a pressionar a alavanca com mais frequência, demonstrando que aprendeu o comportamento por meio do reforço.

Esse tipo de aprendizado serviu como base para algoritmos de machine learning, como o Q-learning, que permite às máquinas aprender comportamentos ótimos de maneira autônoma mediante o método de tentativa e erro.

O que é o Q-learning?

O Q-learning foi introduzido por Christopher Watkins em 1989 como um algoritmo de aprendizado por reforço. Esse algoritmo permite a um agente aprender o valor das ações em um estado determinado, atualizando continuamente seu conhecimento por meio da experiência, assim como o rato da caixa de Skinner.

Ao contrário dos experimentos de Pavlov, nos quais o aprendizado se baseava em associações simples, o Q-learning utiliza um método mais complexo de tentativa e erro. O agente explora diversas ações e atualiza uma tabela Q que armazena os valores Q, os quais representam as recompensas futuras esperadas por tomar a melhor ação em um estado específico.

O Q-learning é aplicado em diversos âmbitos, como por exemplo em sistemas de recomendação (como os utilizados por Netflix ou Spotify), em veículos autônomos (como drones ou robôs) e na otimização de recursos. Agora exploraremos como essa tecnologia pode ser aplicada na neurorreabilitação.

Q-learning e NeuronUP

Uma das vantagens de NeuronUP, é a capacidade de personalizar as atividades segundo as necessidades específicas de cada usuário. No entanto, personalizar cada atividade pode ser tedioso devido ao elevado número de parâmetros a ajustar.

O Q-learning permite automatizar esse processo, ajustando os parâmetros em função do desempenho do usuário nas diferentes atividades. Isso garante que os exercícios sejam exigentes mas alcançáveis, melhorando a eficácia e a motivação durante a reabilitação.

Como funciona?

Nesse contexto, o agente, que poderia ser comparado a um usuário interagindo com uma atividade, aprende a tomar decisões ótimas em diferentes situações para completar corretamente a atividade.

O Q-learning permite ao agente experimentar com diversas ações interagindo com seu ambiente, recebendo recompensas ou penalizações, e atualizando uma tabela Q que armazena esses valores Q. Esses valores representam as recompensas futuras esperadas por tomar a melhor ação em um estado específico.

A regra de atualização de Q-learning é a seguinte:

[Q(s,a) leftarrow Q(s,a) + alphabigl(r + gamma cdot max_{a’}bigl(Q(s’,a’)bigr) – Q(s,a)bigr)]Onde:

𝛂 – é a taxa de aprendizado.

r – é a recompensa recebida após tomar a ação a desde o estado s.

𝛄 – é o fator de desconto, que representa a importância de las recompensas futuras.

s’ – é o estado seguinte.

(max_{a’}bigl(Q(s’,a’)bigr)) – é o valor Q máximo para o estado seguinte s’.

Inscreva-se

na nossa

Newsletter

Exemplo de aplicação em uma atividade de NeuronUP

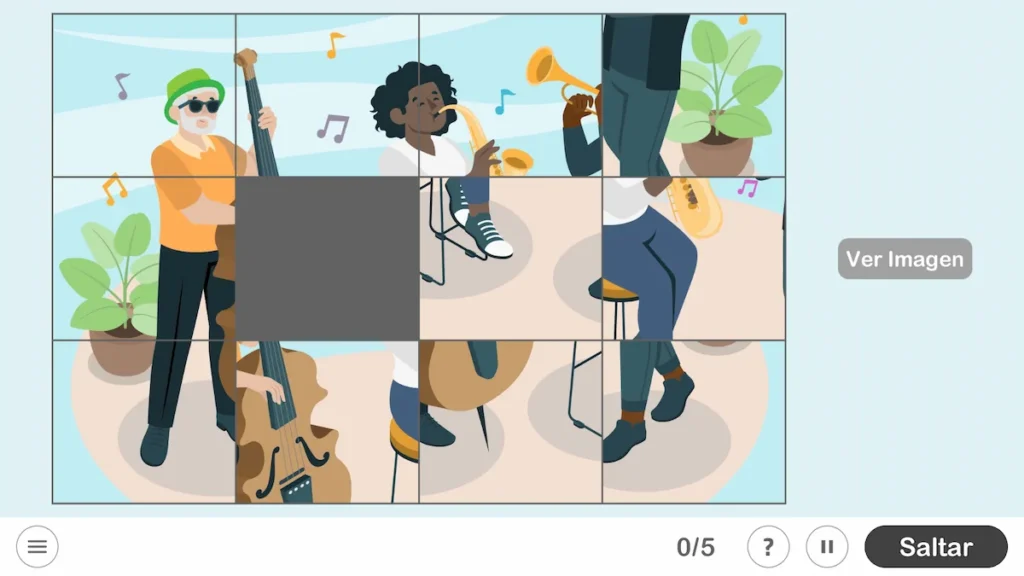

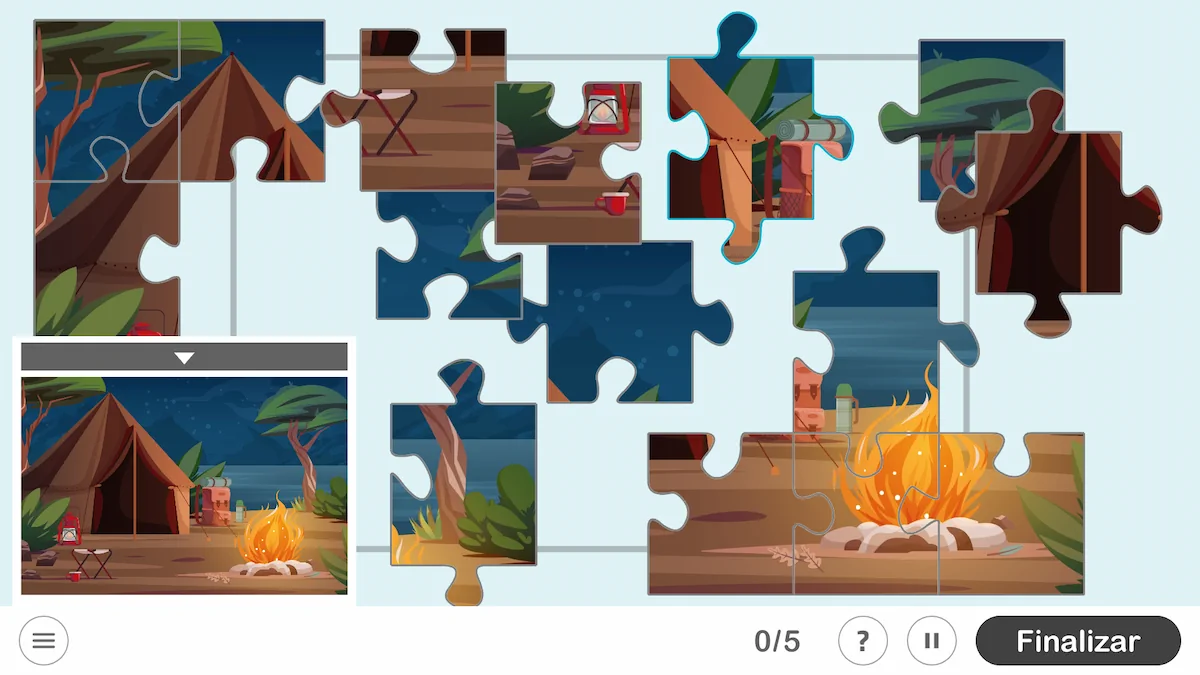

Vamos pegar a atividade do NeuronUP chamada “Imagens misturadas”, que trabalha habilidades como o planejamento, as praxias visoconstrutivas e a relação espacial. Nesta atividade, o objetivo é resolver um quebra-cabeça que foi misturado e cortado em peças.

As variáveis que definem a dificuldade desta atividade são o tamanho da matriz (o número de linhas e de colunas) bem como o valor da desordem das peças (baixo, médio, alto ou muito alto).

Para treinar o agente a resolver o quebra-cabeça, foi criada uma matriz de recompensas baseada no número mínimo de movimentos necessários para resolvê-lo, definido pela seguinte fórmula:

[mathrm{Min_Attempts} ;=;leftlceil frac{mathrm{factor} * mathrm{rows} * mathrm{columns}}{5}rightrceil,quad mathrm{factor}in{1,3,5,7}]A variable factor depende da variável de desordem. Uma vez criada a matriz, foi aplicado um algoritmo de Q-learning para treinar o agente a resolver o quebra-cabeça automaticamente.

Esta integração inclui:

- Recuperación del valor Q: A função recupera o valor Q para um par estado-ação da tabela Q. Se o par estado-ação não tiver sido treinado antes, retorna 0. Esta função busca a recompensa esperada ao tomar uma ação específica em um estado específico.

- Actualización del valor Q: A função atualiza o valor Q para um par estado-ação com base na recompensa recebida e no valor Q máximo do próximo estado. Esta função implementa a regra de atualização de Q-learning mencionada anteriormente.

- Decisión sobre la acción a tomar: A função decide qual ação tomar em um dado estado, usando uma estratégia epsilon-greedy. Essa estratégia equilibra a exploração e o aproveitamento:

- Exploración: Consiste em selecionar a melhor ação conhecida até o momento. Com uma probabilidade ε (taxa de exploração, um valor entre 0 e 1 que determina a probabilidade de explorar novas ações em vez de aproveitar as ações conhecidas), escolhe-se uma ação aleatória, permitindo ao agente descobrir ações potencialmente melhores.

- Explotación: Consiste em testar ações diferentes das melhores conhecidas para descobrir se podem oferecer melhores recompensas no futuro. Com uma probabilidade 1−ε, o agente seleciona a ação com o valor Q mais alto para o estado atual, utilizando seu conhecimento aprendido: a’ = argmaxaQ(s,a). Onde a’ é a ação que maximiza a função Q em um estado s dado. Isso significa que, dado um estado s, selecione a ação a que tem o valor Q mais alto.

Essas funções trabalham juntas para permitir que o algoritmo de Q-learning desenvolva uma estratégia ótima para resolver o quebra-cabeça.

Análisis preliminar de la ejecución del algoritmo

O algoritmo foi aplicado a um quebra-cabeça de matriz 2×3 com um fator de dificuldade de 1 (baixo), correspondente a um número mínimo de tentativas igual a 2. O algoritmo foi executado no mesmo quebra-cabeça 20 vezes, aplicando a mesma configuração de embaralhamento em cada ocasião e atualizando a tabela Q depois de cada passo. Após 20 execuções, o quebra-cabeça foi embaralhado em uma configuração diferente e o processo se repetiu, resultando em um total de 2000 iterações. Os valores iniciais dos parâmetros foram:

- Recompensa por resolver o quebra-cabeça: 100 pontos

- Penalidade por cada movimento: -1 ponto

A cada passo, era aplicada uma recompensa ou penalidade adicional baseada no número de peças corretas, permitindo ao agente compreender seu progresso em direção à resolução do quebra-cabeça. Isso era calculado utilizando a fórmula:

[W times bigl(N_{mathrm{correct}}^i ;-; N_{mathrm{correct}}^{,i-1}bigr)]Onde:

- W é o fator de peso.

- (N_{mathrm{correct}}^{,i}) é o número de peças corretas após o movimento.

- (N_{mathrm{correct}}^{,i-1}) é o número de peças corretas antes do movimento.

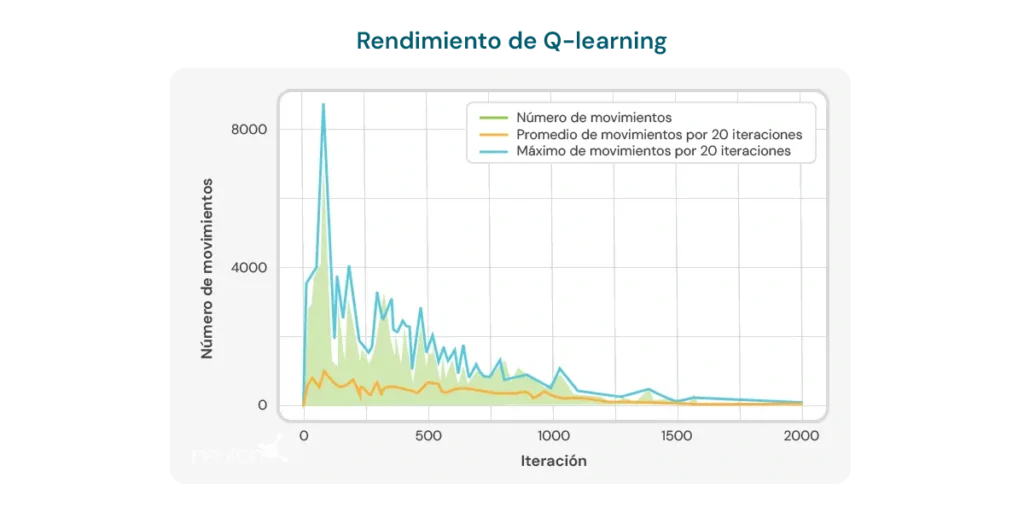

O gráfico a baixo ilustra o número de movimentos necessários por iteração para que o modelo resolva um quebra-cabeça de tamanho 2×3. No início, o modelo requer um grande número de movimentos, o que reflete sua falta de conhecimento sobre como resolver o quebra-cabeça de maneira eficiente. No entanto, à medida que o algoritmo de Q-learning é treinado, observa-se uma tendência de queda no número de movimentos, o que sugere que o modelo está aprendendo a otimizar seu processo de resolução.

Essa tendência é um indício positivo do potencial do algoritmo para melhorar com o tempo. No entanto, várias limitações importantes devem ser consideradas:

- Tamanho específico do quebra-cabeça: O algoritmo demonstra eficácia principalmente em quebra-cabeças com um tamanho específico, como o de matriz 2×3. Ao alterar o tamanho ou a complexidade do quebra-cabeça, o desempenho do algoritmo pode diminuir significativamente.

- Tempo de cálculo: Quando o algoritmo é aplicado a configurações diferentes ou mais complexas, o tempo necessário para realizar os cálculos e resolver o quebra-cabeça aumenta consideravelmente. Isso limita sua aplicabilidade em situações que exigem respostas rápidas ou em quebra-cabeças com maior complexidade.

- Número de movimentos ainda alto: Apesar da melhoria observada, o número de movimentos necessários para resolver o quebra-cabeça continua relativamente alto, mesmo após múltiplas iterações. Nas últimas execuções, o modelo requer uma média de 8 a 10 movimentos, o que indica que ainda há margem para melhorar a eficiência do aprendizado.

Essas limitações ressaltam a necessidade de um refinamento adicional do algoritmo, seja ajustando os parâmetros de aprendizagem, melhorando a estrutura do modelo ou incorporando técnicas complementares que permitam um aprendizado mais eficiente e adaptável a diferentes configurações de quebra-cabeças. Apesar dessas limitações, não devemos esquecer as vantagens que o Q-learning oferece na neurorreabilitação, entre elas:

- A personalização dinâmica das atividades: O Q-learning é capaz de ajustar automaticamente os parâmetros das atividades terapêuticas com base no desempenho individual do usuário. Isso significa que as atividades podem ser personalizadas em tempo real, garantindo que cada usuário trabalhe em um nível que seja desafiador, mas alcançável. Isso é especialmente útil na neurorreabilitação, onde as capacidades dos usuários podem variar consideravelmente e mudar ao longo do tempo.

- Um aumento da motivação e do engajamento: À medida que as atividades se adaptam constantemente ao nível de habilidade do usuário, evita-se a frustração por tarefas demasiado difíceis ou o tédio por tarefas demasiado simples. Isso pode aumentar significativamente a motivação do usuário e seu engajamento com o programa de reabilitação, o que é crucial para alcançar resultados bem-sucedidos.

- A otimização do processo de aprendizagem: Ao utilizar Q-learning, o sistema pode aprender com as interações anteriores do usuário com as atividades, otimizando o processo de aprendizagem e reabilitação. Isso permite que os exercícios sejam mais eficazes, concentrando-se nas áreas em que o usuário precisa de mais atenção e reduzindo o tempo necessário para alcançar os objetivos terapêuticos.

- Eficiência na tomada de decisões clínicas: Os profissionais podem se beneficiar do Q-learning ao obter recomendações baseadas em dados sobre como ajustar as terapias. Isso facilita a tomada de decisões clínicas mais informadas e precisas, o que, por sua vez, melhora a qualidade do atendimento fornecido ao usuário.

- Melhoria contínua: Ao longo do tempo, o sistema baseado em Q-learning pode melhorar seu desempenho por meio do acúmulo de dados e da experiência do usuário. Isso significa que, quanto mais o sistema for usado, mais eficaz ele se torna na personalização e otimização dos exercícios, oferecendo assim uma vantagem a longo prazo no processo de neurorreabilitação.

Concluindo, o Q-learning evoluiu desde suas raízes na psicologia comportamental até se tornar uma ferramenta poderosa na inteligência artificial e na neurorreabilitação. Sua capacidade de adaptar atividades de forma autônoma o torna um recurso valioso para melhorar a eficácia das terapias de reabilitação, embora ainda existam desafios a superar para otimizar completamente sua aplicação.

Bibliografia

- Bermejo Fernández, E. (2017). Aplicação de algoritmos de aprendizado por reforço a jogos.

- Giró Gràcia, X., & Sancho Gil, J. M. (2022). A Inteligência Artificial na educação: Big data, caixas-pretas e solucionismo tecnológico.

- Meyn, S. (2023). Estabilidade do Q-learning por meio do design e do otimismo. arXiv preprint arXiv:2307.02632.

- Morinigo, C., & Fenner, I. (2021). Teorias da aprendizagem. Minerva Magazine of Science, 9(2), 1-36.

- M.-V. Aponte, G. Levieux e S. Natkin. (2009). Medindo o nível de dificuldade em videogames para jogador único. Entertainment Computing.

- P. Jan L., H. Bruce D., P. Shashank, B. Corinne J., & M. Andrew P. (2019). O Efeito do Ajuste de Dificuldade Adaptativa na Eficácia de um Jogo para Desenvolver Habilidades de Função Executiva em Aprendizes de Diferentes Idades. Cognitive Development, pp. 49, 56–67.

- R. Anna N., Z. Matei & G. Thomas L. Projetando Jogos Otimizados para Pesquisa em Ciência Cognitiva. Computer Science Division and Department of Psychology, University of California, Berkeley.

- Toledo Sánchez, M. (2024). Aplicações do aprendizado por reforço em videogames.

As provas dos Jogos Paralímpicos de 2024 e a importância da saúde mental

As provas dos Jogos Paralímpicos de 2024 e a importância da saúde mental

Deixe um comentário