Elina Filatova, cientista de Dados da NeuronUP, expõe neste artigo como o modelo Time-Aware LSTM (TA-LSTM) permite prever com alta precisão os resultados dos usuários mesmo quando seus dados são gerados de forma irregular.

Na NeuronUP implementamos ativamente os métodos mais avançados de aprendizado de máquina que nos permitem prever com alta precisão o comportamento dos usuários, identificar tendências e projetar resultados futuros com base em seus dados históricos.

No entanto, as abordagens tradicionais de aprendizado de máquina enfrentam dificuldades quando os dados são gerados de forma irregular e os intervalos entre observações são caóticos ou específicos para cada usuário. Nesses casos, os modelos convencionais tornam-se ineficazes, pois não consideram o ritmo e a frequência únicos da atividade de cada pessoa.

Exatamente para resolver esse problema utilizamos uma versão especial da rede neural LSTM, denominada Time-Aware LSTM (TA-LSTM). Esse modelo é capaz de considerar de forma eficaz os intervalos temporais entre eventos, permitindo prever séries temporais mesmo quando os dados são irregulares.

Objetivo do estudo e principais dificuldades

Na NeuronUP contamos com métricas do usuário provenientes de dias anteriores, com o objetivo de prever seus resultados na próxima vez que realizarem a atividade. À primeira vista, isso pode parecer uma tarefa simples, mas na prática surgem várias dificuldades importantes:

- Ritmo individual dos usuários: Cada usuário tem um padrão único de treinamento; alguns jogam diariamente, outros semanalmente, e alguns podem fazer pausas prolongadas de até um mês, retornando inesperadamente às atividades. Por exemplo, Alex treina de forma estável todos os dias, enquanto José prefere intervalos semanais. Se os resultados forem promediados sem considerar essa frequência, perder-se-ão detalhes cruciais.

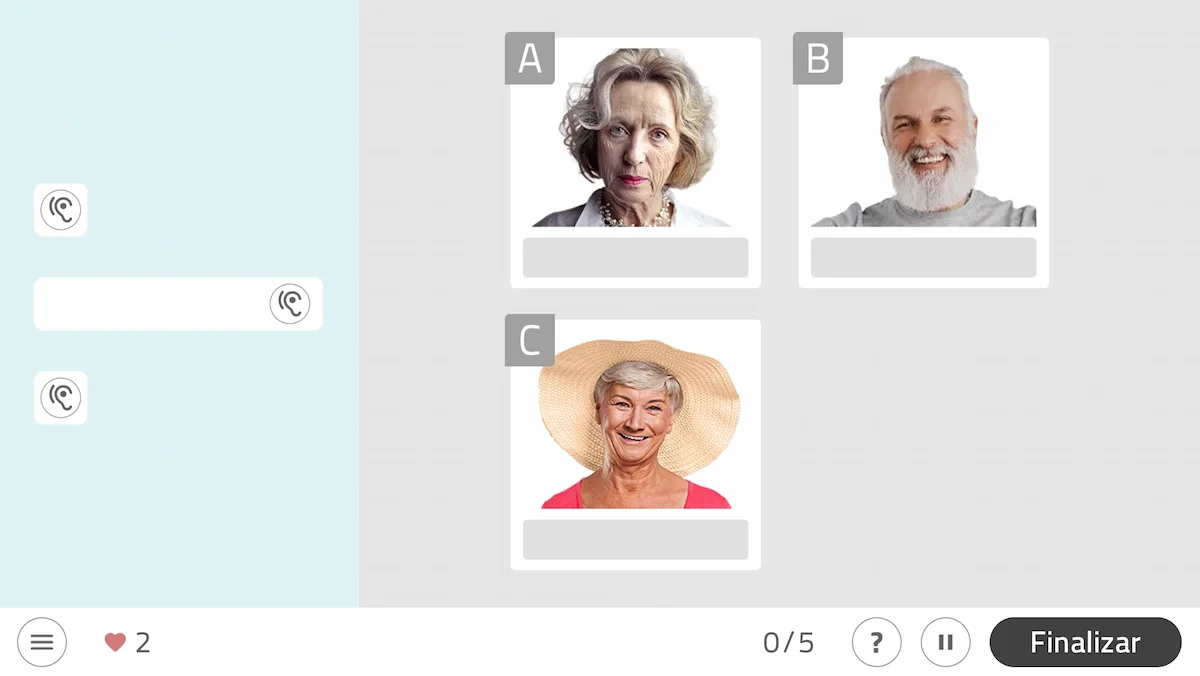

- Variedade de atividades e seu impacto diferencial nos usuários: As atividades na NeuronUP são projetadas para melhorar diferentes funções cognitivas como memória, atenção e lógica, entre outras. Cada atividade possui um nível de dificuldade particular que varia conforme o usuário. O que é simples para uma pessoa pode representar um grande desafio para outra.

- Foco em atividades específicas: Os especialistas da NeuronUP determinam quais atividades atribuir a cada usuário. Por exemplo, Carmen realiza regularmente exercícios de memória, lógica e matemática, enquanto Pablo prefere exclusivamente exercícios de atenção. Portanto, o modelo preditivo deve considerar o caminho personalizado de cada jogador.

Claro, todos esses nuances complicam tanto o processo adequado de preparação dos dados quanto o próprio treinamento dos modelos de aprendizado de máquina. Ignorar o ritmo individual dos jogadores, seus intervalos irregulares e os diferentes níveis de dificuldade das atividades inevitavelmente conduz à perda de informação chave. Como consequência, existe o risco de obter previsões menos precisas, o que por sua vez pode reduzir a eficácia das recomendações personalizadas na NeuronUP.

Inscreva-se

na nossa

Newsletter

Solução: Time-Aware LSTM

Para superar eficazmente todas as dificuldades mencionadas anteriormente, a equipe de dados da NeuronUP desenvolveu uma solução específica baseada no modelo personalizado Time-Aware LSTM (TA-LSTM). Esta é uma versão aprimorada da rede neural padrão LSTM, capaz de considerar não apenas os eventos nas séries temporais, mas também os intervalos de tempo entre eles.

Preparação de dados: por que a diferença temporal é tão importante?

Nosso modelo recebe como entrada dados preparados de uma maneira específica. Cada registro é uma matriz bidimensional que contém os resultados sequenciais de um jogador, ordenados cronologicamente, bem como os intervalos de tempo em dias entre cada vez que realizou a atividade. Para entender por que é tão importante considerar a diferença temporal, conheçamos dois personagens que nos ajudarão a ilustrar este ponto de maneira clara.

Imagine uma maratona chamada “O mais rápido e ágil”, para a qual se preparam dois atletas:

- Neuronito – um esportista disciplinado e determinado. Nunca falta a um treino, trabalha em si mesmo todos os dias e cuida meticulosamente de sua alimentação. Neuronito progride constantemente: a cada nova sessão de treino torna-se mais rápido, resistente e confiante. Dado seu ritmo de preparação estável, podemos prever facilmente que terá um desempenho excelente na maratona.

- Lentonito – um atleta talentoso, mas menos disciplinado. Seus treinos são irregulares. Hoje treina com entusiasmo, mas amanhã prefere descansar desfrutando de sua paella e um bom presunto. Essas sessões inconstantes geram flutuações em seu desempenho: às vezes melhora, outras vezes não, mas sem um crescimento estável. É provável que Lentonito chegue à meta com resultados menos impressionantes.

Dessa forma, vimos com um exemplo simples o quanto os intervalos de tempo entre eventos influenciam os resultados finais. Exatamente essa informação sobre estabilidade e regularidade nos “treinos” é a que fornecemos ao nosso modelo.

Se não considerarmos os intervalos de tempo, o modelo perceberia esses dois atletas como iguais, sem notar a diferença em sua abordagem de treinamento. Mas o TA-LSTM detecta essa característica chave, analisa os intervalos individuais entre eventos e faz previsões mais precisas, levando em conta o ritmo único de cada participante (ou, no nosso caso na NeuronUP, do usuário).

Mas isso não é tudo! Como você deve ter notado, também mencionamos a alimentação de Neuronito e Lentonito. Não por acaso, mas porque esses dados representam características adicionais que também influenciam significativamente o resultado final.

De maneira semelhante, nosso modelo é capaz de considerar não apenas os intervalos de tempo, mas também outras características importantes, como a idade, o gênero, o diagnóstico e até mesmo as preferências dos usuários.

Isso permite melhorar consideravelmente a precisão das previsões, como em nosso exemplo com os protagonistas, onde levamos em conta sua dieta e sua influência no sucesso.

Detalhes técnicos

Agora que vimos o conceito principal, vamos ao aspecto técnico do funcionamento do modelo Time-Aware LSTM (TA-LSTM). Este modelo é uma modificação da célula LSTM padrão, projetada especificamente para levar em conta os intervalos de tempo entre eventos sequenciais.

O objetivo principal do TA-LSTM é a atualização adaptativa do estado interno de memória do modelo em função do tempo decorrido desde a última observação. Essa abordagem é crucial quando se trabalha com séries temporais irregulares, exatamente o tipo de dados com que lidamos na NeuronUP.

O vetor de entrada no instante de tempo t está representado como:

[text{inputs}_{t} = [x_{t},,Delta t]]Onde:

- (x_t in mathbb{R}^d) – é o vetor de características que descreve o evento atual (cada dia em que a atividade é realizada).

- (Delta t in mathbb{R}) – é o intervalo de tempo entre a observação atual e a anterior.

Os estados anteriores do modelo são representados da maneira padrão:

[h_{t-1},; C_{t-1}]Onde:

- (h_{t-1}) – é o vetor de estado oculto no passo anterior.

- (C_{t-1}) – é o estado de memória (célula LSTM) no passo anterior.

Para levar em conta a influência do intervalo de tempo t, o modelo emprega um mecanismo especial de atenuação da memória, descrito pela seguinte fórmula:

[gamma_t = e^{-text{RELU}(w_d cdot Delta t + b_d)}]Onde:

- (w_d, ; b_d) – são parâmetros treináveis do modelo.

- (text{RELU}(x) = max(0, x)) – é a função de ativação que evita valores negativos.

O coeficiente de atenuação (gamma_t) controla a atualização do estado de memória.

A atualização da memória é definida como:

[bar{C}_{t-1} = gamma_t cdot C_{t-1}]Isso significa que quando o intervalo de tempo aumenta, o valor de tende a zero, o que provoca um maior “esquecimento” dos estados de memória anteriores.

No passo seguinte, o estado de memória corrigido (bar{C}_{t-1}) é introduzido nas equações padrão do LSTM:

[h_t, ; C_t = text{LSTM}(x_{t’}, h_{t-1}, bar{C}_{t-1})]Os valores de saída (h_t) e o estado de memória atualizado (C_t) são utilizados no próximo passo do modelo, o que garante uma previsão precisa e a capacidade de considerar intervalos de tempo irregulares entre eventos.

Por que utilizar a previsão?

O uso da previsão nos permite antecipar com alta precisão os resultados futuros de um paciente, analisando previamente seus dados através do nosso modelo personalizado TA-LSTM. Para verificar a precisão das previsões, selecionamos uma amostra de dados de pacientes reais e aplicamos o modelo com base em seus registros prévios de atividade. O último dia de atividade de cada paciente foi excluído dos dados para comparar o resultado real com a previsão gerada pelo modelo.

Na maioria dos casos, os resultados previstos pelo nosso modelo coincidiram de perto com os valores reais dos jogadores. No entanto, também identificamos algumas exceções interessantes nas quais a previsão diferiu significativamente do resultado real.

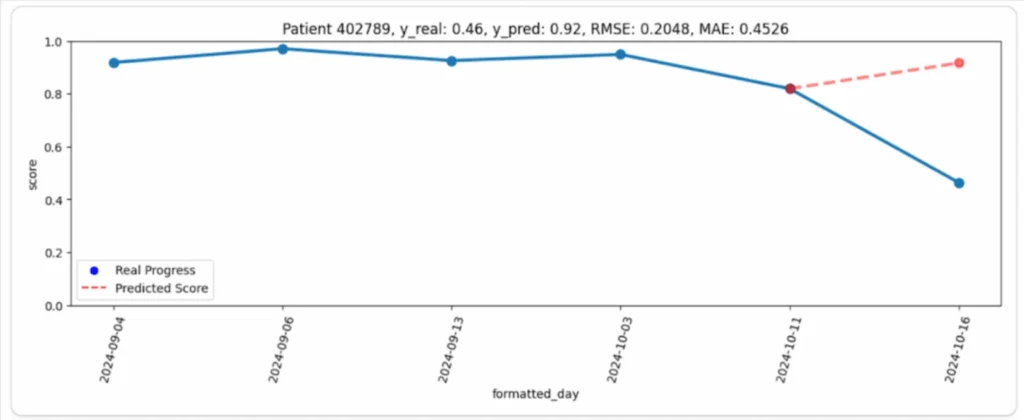

Por exemplo, no gráfico a seguir (Imagem 1), pode-se observar o progresso do paciente (linha azul) e a previsão correspondente do modelo (linha vermelha). À primeira vista, a diferença parece bastante grande: o paciente manteve um desempenho alto e estável durante todo o período de observação, mas seu último resultado foi inesperadamente muito mais baixo do que o previsto. Neste caso, a previsão do modelo parecia muito mais lógica do que o resultado real.

Por que isso aconteceu?

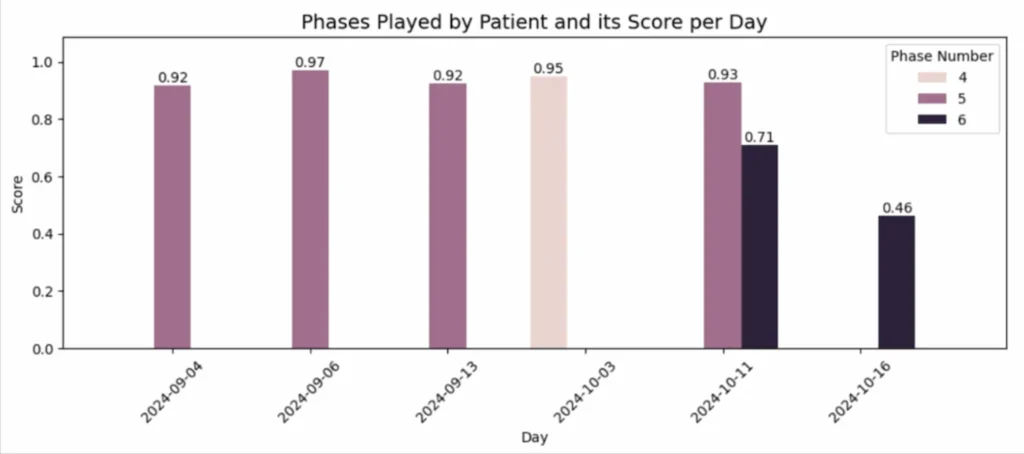

A razão revelou-se simples mas importante: em todos os dias anteriores, o paciente jogou em níveis (fases) mais fáceis, obtendo pontuações consistentemente altas. No entanto, no último dia, escolheu a fase 6, que era mais difícil, o que provocou uma queda notável em seu desempenho (Imagem 2).

Dessa forma, a previsão do modelo permitiu reconhecer uma desviação inesperada do comportamento habitual do paciente, identificando que foi causada por um aumento no nível de dificuldade.

Conclusão

O uso do Time-Aware LSTM abre novas possibilidades para a previsão precisa de séries temporais com intervalos irregulares. Ao contrário dos modelos tradicionais, o TA-LSTM é capaz de se adaptar ao ritmo único de cada jogador, levando em conta suas pausas e intervalos de atividade. Graças a essa abordagem, nossa plataforma de estimulação cognitiva não só pode prever com precisão os resultados futuros dos pacientes, mas também detectar de maneira oportuna possíveis anomalias ou desvios inesperados.

Na NeuronUP valorizamos seu tempo e sempre buscamos aplicar as tecnologias mais eficazes, inovadoras e avançadas. Fique atento às nossas atualizações, o melhor está por vir!

Bibliografia

- Lechner, Mathias, and Ramin Hasani. “Learning Long-Term Dependencies in Irregularly-Sampled Time Series.” arXiv preprint arXiv:2006.04418, vol. -, no. -, 2020, pp. 1-11.

- Michigan State University, et al. “Patient Subtyping via Time-Aware LSTM Networks.” Proceedings of the 23rd ACM SIGKDD International Conference on Knowledge Discovery and Data Mining (KDD ’17), vol. -, no. -, 2017, pp. 65-74.

- Nguyen, An, et al. “Time Matters: Time-Aware LSTMs for Predictive Business Process Monitoring.” Lecture Notes in Business Information Processing, Process Mining Workshops, vol. 406, no. -, 2021, pp. 112–123.

- Schirmer, Mona, et al. “Modeling Irregular Time Series with Continuous Recurrent Units.” Proceedings of the 39th International Conference on Machine Learning (ICML 2022), vol. 162, no. -, 2022, pp. 19388-19405.

- “Time aware long short-term memory.” Wikipedia, https://en.wikipedia.org/wiki/Time_aware_long_short-term_memory. Acessado em 12 de março de 2025.

Deixe um comentário